Za BMS, BUS, industrijske, instrumentalne kable.

Elon Musk in ekipa xAI sta med prenosom v živo uradno predstavila najnovejšo različico Groka, Grok3. Pred tem dogodkom je veliko s tem povezanih informacij, skupaj z Muskovim 24/7 promocijskim pompom, dvignilo globalna pričakovanja glede Grok3 na izjemno raven. Pred samo tednom dni je Musk med prenosom v živo, ko je komentiral DeepSeek R1, samozavestno izjavil: "xAI bo kmalu predstavil boljši model umetne inteligence." Glede na podatke, predstavljene v živo, naj bi Grok3 presegel vse trenutne mainstream modele v merilih za matematiko, znanost in programiranje, Musk pa je celo trdil, da se bo Grok3 uporabljal za računske naloge, povezane z misijami SpaceX na Mars, in napovedal "preboje na ravni Nobelove nagrade v treh letih". Vendar so to trenutno le Muskove trditve. Po izstrelitvi sem preizkusil najnovejšo beta različico Grok3 in postavil klasično zvijačno vprašanje za velike modele: "Kateri je večji, 9,11 ali 9,9?" Žal tako imenovani najpametnejši Grok3 brez kakršnih koli kvalifikacij ali oznak še vedno ni mogel pravilno odgovoriti na to vprašanje. Grok3 ni natančno opredelil pomena vprašanja.

Ta test je hitro pritegnil precejšnjo pozornost mnogih prijateljev in po naključju so različni podobni testi v tujini pokazali, da se Grok3 muči z osnovnimi fizikalno-matematičnimi vprašanji, kot je "Katera krogla prva pade s poševnega stolpa v Pisi?". Zato so ga šaljivo označili za "genija, ki ni pripravljen odgovoriti na preprosta vprašanja".

Grok3 je dober, vendar ni boljši od R1 ali o1-Pro.

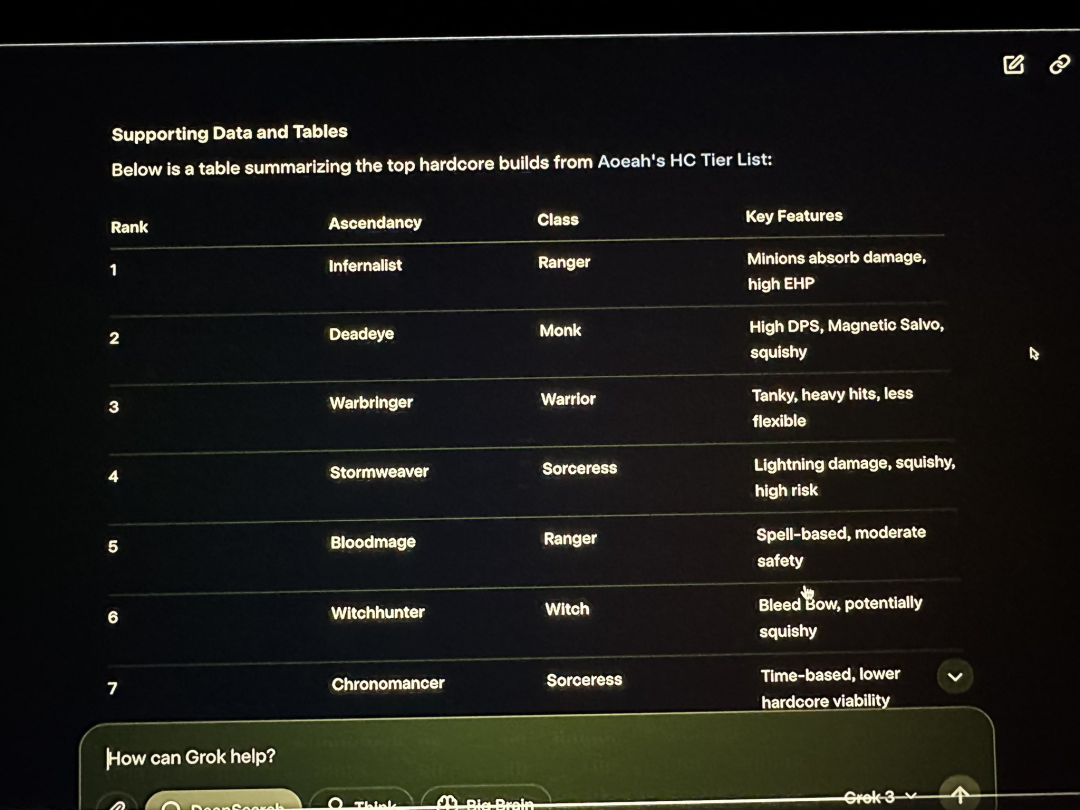

Grok3 je v praksi na številnih testih splošnega znanja doživel "neuspehe". Med predstavitvijo xAI je Musk demonstriral uporabo Grok3 za analizo razredov likov in učinkov iz igre Path of Exile 2, za katero je trdil, da jo pogosto igra, vendar je bila večina odgovorov, ki jih je podal Grok3, napačnih. Musk med prenosom v živo ni opazil te očitne težave.

Ta napaka ni le zagotovila dodatnega dokaza za posmeh tujim uporabnikom interneta, ker se Musku "poslužuje iger na srečo", temveč je sprožila tudi precejšnje pomisleke glede zanesljivosti Grok3 v praktičnih aplikacijah. Za takšnega "genija", ne glede na njegove dejanske zmogljivosti, ostaja njegova zanesljivost v izjemno kompleksnih scenarijih uporabe, kot so naloge raziskovanja Marsa, vprašljiva.

Trenutno mnogi preizkuševalci, ki so pred tedni dobili dostop do Grok3, in tisti, ki so včeraj le nekaj ur testirali zmogljivosti modela, vsi kažejo na skupen zaključek: "Grok3 je dober, vendar ni boljši od R1 ali o1-Pro."

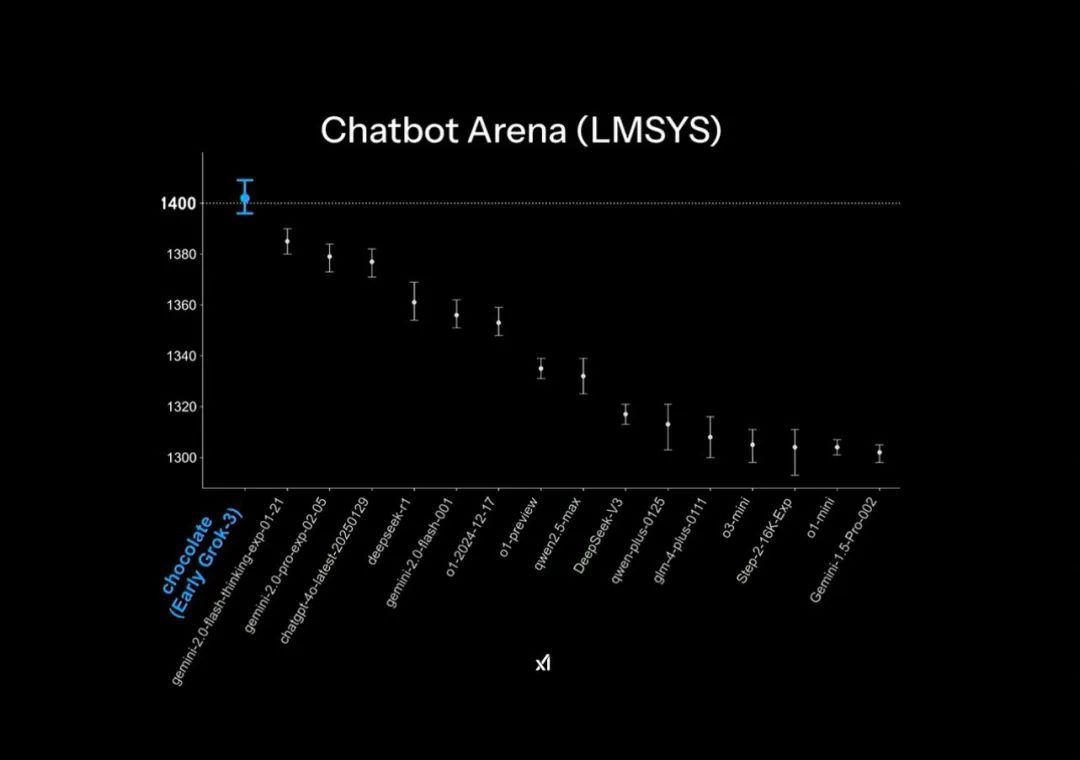

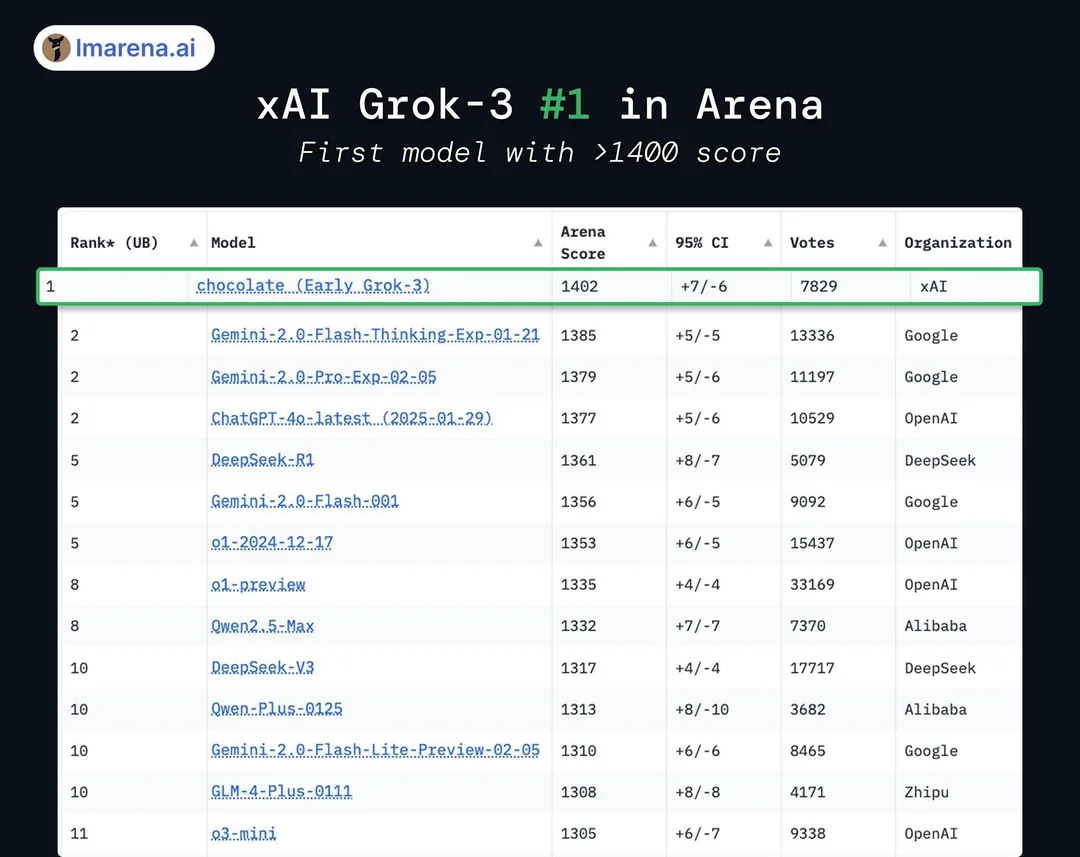

Kritični pogled na "prekinitev delovanja Nvidie"

V uradno predstavljeni predstavitvi PPT med izdajo se je izkazalo, da je Grok3 v Areni klepetalnih robotov »daleč pred drugimi«, vendar je bil pri tem spretno uporabljen grafični pristop: navpična os na lestvici najboljših je prikazala le rezultate v razponu točk od 1400 do 1300, zaradi česar je bila prvotna 1-odstotna razlika v rezultatih testov v tej predstavitvi videti izjemno pomembna.

V dejanskih rezultatih ocenjevanja modelov je Grok3 le 1-2 % pred DeepSeek R1 in GPT-4.0, kar ustreza izkušnjam mnogih uporabnikov v praktičnih testih, ki niso odkrili "opazne razlike". Grok3 svoje naslednike presega le za 1-2 %.

Čeprav je Grok3 dosegel višje rezultate od vseh trenutno javno testiranih modelov, mnogi tega ne jemljejo resno: navsezadnje je bil xAI v eri Grok2 že prej kritiziran zaradi "manipulacije z rezultati". Ker je lestvica najboljših kaznovala slog dolžine odgovorov, so se rezultati močno znižali, zaradi česar so strokovnjaki iz industrije pogosto kritizirali pojav "visokega števila rezultatov, a nizke sposobnosti".

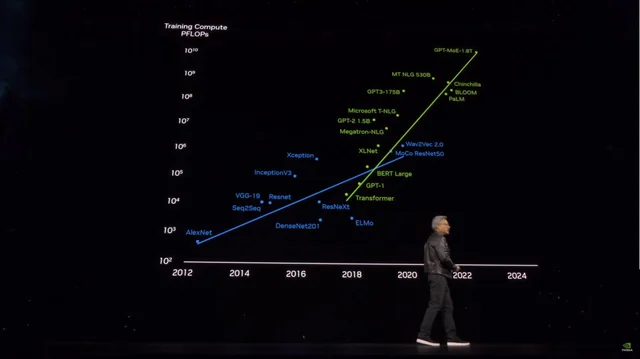

Naj gre za »manipulacijo« lestvice najboljših ali oblikovalske trike v ilustracijah, razkrivajo xAI in Muskovo obsedenost z idejo »vodenja« v zmogljivostih modelov. Musk je za te prednosti plačal visoko ceno: med predstavitvijo se je hvalil z uporabo 200.000 grafičnih procesorjev H100 (med prenosom v živo je trdil, da je uporabil »več kot 100.000«) in dosegel skupni čas učenja 200 milijonov ur. Zaradi tega so nekateri verjeli, da to predstavlja še eno pomembno prednost za industrijo grafičnih procesorjev, vpliv DeepSeeka na sektor pa so označili za »neumnega«. Nekateri menijo, da bo prihodnost učenja modelov zgolj računska moč.

Vendar pa so nekateri uporabniki interneta primerjali porabo 2000 grafičnih procesorjev H800 v dveh mesecih za izdelavo DeepSeek V3 in izračunali, da je dejanska poraba energije Grok3 med učenjem 263-krat večja od porabe V3. Razlika med DeepSeek V3, ki je dosegel 1402 točki, in Grok3 je nekaj manj kot 100 točk. Po objavi teh podatkov so mnogi hitro spoznali, da se za nazivom Grok3 kot "najmočnejšega na svetu" skriva jasen mejni učinek uporabnosti – logika večjih modelov, ki ustvarjajo večjo zmogljivost, je začela kazati manjše donose.

Kljub "visokim rezultatom, a nizkim sposobnostim" je imel Grok2 na voljo ogromne količine visokokakovostnih podatkov iz prve roke s platforme X (Twitter) za podporo uporabe. Vendar pa je pri učenju Grok3 xAI seveda naletel na "zgornjo mejo", s katero se trenutno sooča OpenAI – pomanjkanje vrhunskih podatkov za učenje hitro razkrije mejno uporabnost zmogljivosti modela.

Razvijalci Grok3 in Musk so verjetno prvi, ki bodo ta dejstva razumeli in poglobljeno prepoznali, zato Musk na družbenih omrežjih nenehno omenja, da je različica, ki jo uporabniki trenutno uporabljajo, "še vedno le beta" in da "bo polna različica izdana v prihodnjih mesecih". Musk je prevzel vlogo vodje produktov pri Grok3 in uporabnikom predlagal, da v razdelku s komentarji posredujejo povratne informacije o različnih težavah. Morda je najbolj spremljan vodja produktov na Zemlji.

Vendar pa je Grok3 v enem dnevu nedvomno sprožil alarm pri tistih, ki upajo, da se bodo za usposabljanje močnejših velikih modelov zanesli na "ogromno računalniško moč": na podlagi javno dostopnih Microsoftovih informacij ima OpenAI GPT-4 velikost parametrov 1,8 bilijona parametrov, kar je več kot desetkrat več kot pri GPT-3. Govorice kažejo, da bi lahko bila velikost parametrov GPT-4.5 še večja.

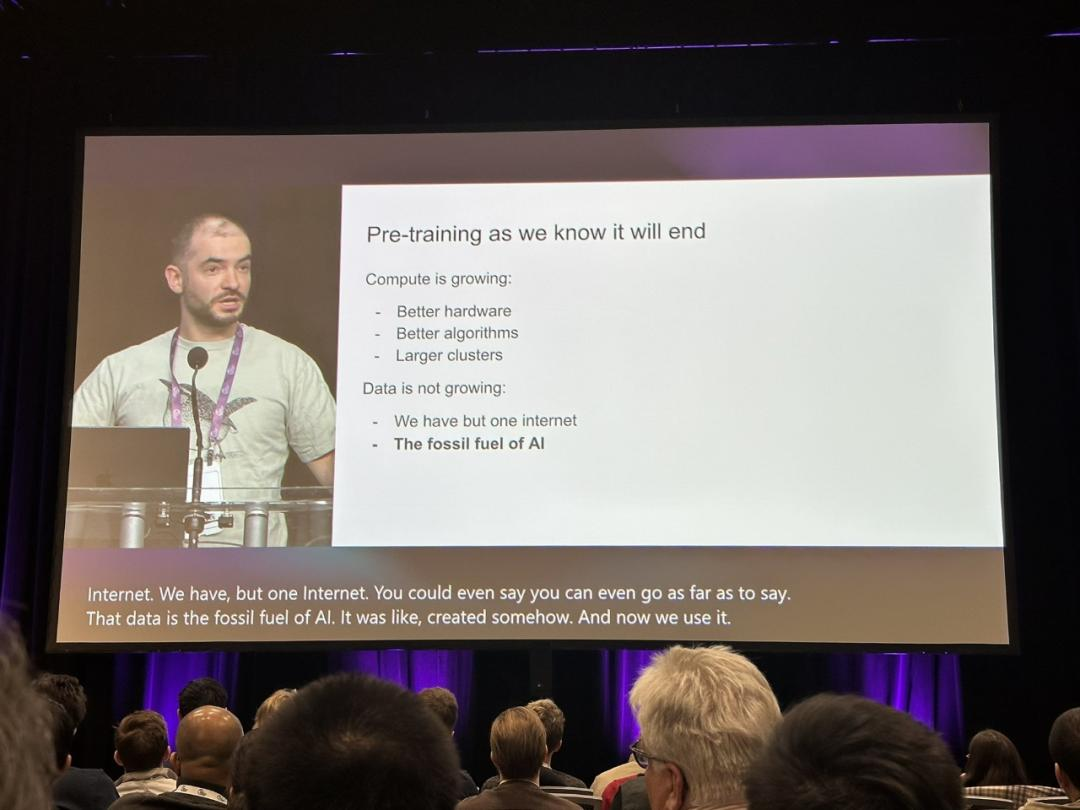

Z naraščanjem velikosti parametrov modela strmo naraščajo tudi stroški usposabljanja. S prisotnostjo Grok3 morajo tekmeci, kot je GPT-4.5 in drugi, ki želijo še naprej »kuriti denar« za doseganje boljše učinkovitosti modela z velikostjo parametrov, upoštevati zgornjo mejo, ki je zdaj jasno vidna, in razmisliti, kako jo premagati. Ilya Sutskever, nekdanji glavni znanstvenik pri OpenAI, je decembra lani izjavil: »Predhodno usposabljanje, ki ga poznamo, se bo končalo,« kar se je ponovno pojavilo v razpravah in spodbudilo prizadevanja za iskanje prave poti za usposabljanje velikih modelov.

Iljino stališče je v panogi sprožilo alarm. Natančno je predvidel skorajšnjo izčrpanost dostopnih novih podatkov, kar bo vodilo v situacijo, ko zmogljivosti ne bo mogoče več izboljševati z zbiranjem podatkov, in to primerjal z izčrpanostjo fosilnih goriv. Navedel je, da je »tako kot nafta tudi vsebina, ki jo ustvari človek na internetu, omejen vir«. Po Sutskeverjevih napovedih bo naslednja generacija modelov po predhodnem usposabljanju imela »resnično avtonomijo« in sposobnosti sklepanja, »podobne človeškim možganom«.

Za razliko od današnjih vnaprej naučenih modelov, ki se v prvi vrsti zanašajo na ujemanje vsebine (na podlagi predhodno naučene vsebine modela), se bodo prihodnji sistemi umetne inteligence lahko učili in vzpostavljali metodologije za reševanje problemov na način, podoben "razmišljanju" človeških možganov. Človek lahko doseže temeljno znanje na določenem področju že z osnovno strokovno literaturo, medtem ko velik model umetne inteligence potrebuje milijone podatkovnih točk, da doseže le najosnovnejšo učinkovitost na začetni ravni. Tudi če se besedilo nekoliko spremeni, teh temeljnih vprašanj morda ne bo pravilno razumljeno, kar kaže na to, da se inteligenca modela ni resnično izboljšala: osnovna, a nerešljiva vprašanja, omenjena na začetku članka, predstavljajo jasen primer tega pojava.

Zaključek

Vendar pa bi imelo Grok3 poleg surove sile resnične posledice za to področje, če bi industriji resnično uspelo razkriti, da se "predhodno usposobljeni modeli bližajo koncu".

Morda bomo po tem, ko se bo mrzlica okoli Grok3 postopoma polegla, priča več primerom, kot je primer Fei-Fei Lija o "uglaševanju visokozmogljivih modelov na določenem naboru podatkov za samo 50 dolarjev", kar bo na koncu odkrilo pravo pot do splošne umetne inteligence.

Krmilni kabli

Strukturirani kabelski sistem

Omrežje in podatki, optični kabel, povezovalni kabel, moduli, prednja plošča

16.–18. april 2024 Bližnjevzhodna energija v Dubaju

16.–18. april 2024 Securika v Moskvi

9. maj 2024, DOGODEK OB PREDSTAVITVI NOVIH IZDELKOV IN TEHNOLOGIJ v Šanghaju

22.–25. oktober 2024 SECURITY CHINA v Pekingu

19.–20. november 2024 CONNECTED WORLD KSA

Čas objave: 19. februar 2025